קצב ההתקדמות המהיר של מודלי שפה גדולים (LLM) מעלה שתי שאלות חשובות במיוחד עבור מחקר היישור (alignment):

הראשונה היא כיצד מחקר היישור יכול להישאר בקצב ההתפתחות. מודלי AI חזיתיים (frontier models) כבר תורמים לפיתוח היורשים שלהם. אך האם הם יכולים לספק סיוע דומה גם לחוקרי יישור? האם מודלי השפה שלנו יכולים לשמש כדי לסייע ליישר את עצמם?

השאלה השנייה היא מה נעשה ברגע שמודלים יהפכו לחכמים יותר מאיתנו. יישור מודלי AI חכמים יותר מבני אדם הוא תחום מחקר המכונה 'פיקוח סקיילינג' (scalable oversight). פיקוח סקיילינג נדון במידה רבה במונחים תיאורטיים בלבד, אך בקצב ההתקדמות הנוכחי של ה-AI, ייתכן שזה לא יישאר המצב זמן רב. לדוגמה, מודלים כבר מייצרים כמויות אדירות של קוד. אם כישוריהם יתקדמו עד לנקודה שבה הם ייצרו מיליוני שורות קוד מורכב להפליא שאיננו יכולים לנתח בעצמנו, זה עלול להפוך לקשה מאוד לדעת אם הם פועלים בדרכים שאנו מתכוונים אליהן.

במחקר חדש של Anthropic Fellows, אנו בוחנים את שתי השאלות הללו.

המחקר החדש שלנו מתמקד בבעיה המכונה 'פיקוח מחלש לחזק' (weak-to-strong supervision), בעיה המשקפת את האתגר של פיקוח על מודלי AI חכמים מבני אדם. אנו מתחילים עם מודל 'בסיס' חזק יחסית – כלומר, מודל בעל פוטנציאל גבוה שעדיין לא עבר כוונון עדין (fine-tuning) כדי לספק את התשובות הטובות ביותר האפשריות.

לאחר מכן, אנו משתמשים במודל חלש בהרבה כ'מורה' כדי לספק את הכוונון העדין הנוסף הזה, כשהוא מדגים למודל הבסיס החזק את מה שהוא עצמו רואה כפלט אידיאלי. לבסוף, אנו מעריכים עד כמה המודל החזק מתפקד היטב לאחר הכוונון העדין ה'חלש' הזה.

במקרה הגרוע ביותר, המודל החזק יהיה טוב רק כמו המורה החלש שלו. עם זאת, באופן אידיאלי, המודל החזק ילמד מהפידבק של המורה החלש – הוא יפרש את האותות החלשים הללו באופן מועיל, תוך שימוש בפידבק זה כדי לשפר את ביצועיו. אנו יכולים לכמת עד כמה הוא עשה זאת: אם המודל החזק לא מראה שיפור כלל (הוא מתפקד רק באותה מידה כמו המורה החלש שלו), אנו מדרגים אותו ב-0; אם הוא משתמש בפידבק של המורה כדי להשיג את התוצאה האידיאלית – הביצועים הטובים ביותר שהמודל החזק יכול לספק – אנו מדרגים אותו ב-1. מדד זה מייצג את 'פער הביצועים שהוחזר' (בין המודל החלש לגבול העליון של המודל החזק), או ה-PGR (Performance Gap Recovered).

כתחליף לפיקוח סקיילינג, המודל החלש מייצג בני אדם, והמודל החזק מייצג את המודלים החכמים בהרבה מבני אדם שנצטרך לפקח עליהם יום אחד. אם נוכל להתקדם בפיקוח מחלש לחזק, ייתכן שנגלה שהשיטות שלנו יעזרו לנו לשמור על המודלים החכמים במיוחד האלה מיושרים לערכים שלנו.

המחקר החדש שלנו בודק אם Claude יכול לגלות באופן אוטונומי דרכים לשיפור ה-PGR. אנו שואלים: האם Claude יכול לפתח, לבחון ולנתח רעיונות יישור משלו? ואם כן, מה זה עשוי להעיד על מידת ההאצה שמודלי ה-AI של היום יכולים להביא לקצב מחקר היישור?

הניסוי והמתודולוגיה שלנו

כדי לברר זאת, התחלנו עם תשעה עותקים של Claude Opus 4.6, והענקנו לכל אחד מהם כמה כלים נוספים. לכל Claude היה מקום עבודה וחשיבה (כלומר, סביבת Sandbox), פורום משותף להפצת ממצאיו עם האחרים, מערכת אחסון להעלאת הקוד שלו, ושרת מרוחק שבו הוא יכול לקבל ציון PGR עבור כל אחד מרעיונותיו. סיפקנו גם ידע רקע על אימון מודלים והסקה (inference). התייחסנו למודלי ה-Claude המצוידים בכלים אלה כ'חוקרי יישור אוטומטיים' (Automated Alignment Researchers, או AARs).

כדי למנוע מכל AAR לרדוף אחר רעיונות כמעט זהים, סיפקנו לכל אחד מהם פרומפט התחלתי שונה במקצת (אך מעורפל בכוונה): המלצנו לאחד להשתמש בכלי פרשנות (interpretability), לאחר לחשוב על שקילת נתונים מחדש במערך הנתונים, וכן הלאה. מעבר לכך, לא אמרנו ל-AARs מה לעשות. הם היו אחראים להציע רעיונות משלהם, לבצע את הניסויים שלהם, לנתח את תוצאותיהם ולשתף את ממצאיהם וקודם זה עם זה כדי להבין מה לנסות הלאה.

ממצאים מרכזיים ולקחים

כדי לספק מדד ביצועים (benchmark) לתוצאות ה-AARs, השווינו את עבודתם לביצועים אנושיים. שני חוקרים שלנו בילו שבעה ימים באיטרציה על ארבע משיטות ההכללה (generalization) המבטיחות ביותר ממחקרים קודמים. במודלי הקוד הפתוח שבחנו (Qwen 3-4B-Base כמודל החזק, Qwen 1.5-0.5B-Chat כמורה החלש), בני האדם החזירו 23% מכלל פער הביצועים (כלומר, השיגו PGR של 0.23).

Claude שיפר תוצאה זו באופן דרמטי. לאחר חמישה ימים נוספים (ו-800 שעות מחקר מצטברות), ה-AARs סגרו כמעט את כל פער הביצועים שנותר, והגיעו ל-PGR סופי של 0.97. עלות זו הסתכמה בכ-18,000 דולר בטוקנים ובהוצאות אימון מודלים, או 22 דולר לשעת AAR. ניתן לראות כיצד כל AAR בודד התקדם מהביצועים האנושיים (ב-0 שעות).

התובנה: Claude הציג ביצועים יוצאי דופן. אך עד כמה שיטותיו היו יצירתיות, והאם הן יכולות להיות שימושיות ביישומים בעולם האמיתי? כדי לברר זאת, ביצענו שני מבחנים נוספים.

ראשית, בדקנו אם רעיונות ה-AARs יכולים לשחזר את פער הביצועים על מערכי נתונים לא מוכרים – כלומר, על משימות שה-AARs לא ראו בעבר. לקחנו את שתי השיטות בעלות הביצועים הגבוהים ביותר של ה-AARs (על מערך נתונים של משימות צ'אט) ויישמנו אותן על משימות מתמטיקה וקידוד (coding). כאן, התוצאות שלנו היו מבטיחות יחסית: השיטה היעילה ביותר של ה-AARs הכללה בהצלחה לשני מערכי הנתונים החדשים, עם PGR של 0.94 במתמטיקה ו-0.47 בקידוד (שעדיין היה כפול מהביצועים האנושיים). השיטה השנייה בטיבה של ה-AARs הציגה תוצאות מעורבות: היא עבדה במתמטיקה (0.75), אך לא בקוד, שם היא אף החמירה את המצב. תוצאות אלו מצביעות על כך שייתכן שקיימת יכולת הכללה מסוימת במחקר ה-AARs, אך היא אינה מובנת מאליה. אנו מעודדים אחרים שמנסים ניסויים במחקר אוטומטי לבחון את רעיונות ה-AARs גם כנגד מערכי נתונים לא מוכרים.

בשלב הבא, בדקנו אם רעיונות ה-AARs יעבדו בקנה מידה של פריסה (deployment). ניסינו את השיטה היעילה ביותר של ה-AARs על Claude Sonnet 4 עם תשתית האימון שלנו בסביבת פרודקשן. אולם, כאן זכינו לפחות הצלחה. שיטת ה-AARs לא הובילה לשיפור מובהק סטטיסטית. אנו חושבים שזה עשוי לשקף מגבלות של ניסוי מוקדם זה, ולא משהו מהותי יותר: שיטת הניקוד שלנו הייתה פשוטה למדי, והערכנו רק רעיון אחד. עם זאת, זה כן מדגים מגבלה של AARs (לפחות ביכולותיהם הנוכחיות): AARs נוטים לנצל הזדמנויות ייחודיות למודלים ולמערכי הנתונים שניתנו להם, מה שאומר ששיטותיהם עשויות לא לעבוד במקומות אחרים. כדי למתן זאת, אנו מציעים לאפשר ל-AARs לבחון את עצמם כנגד תחומים ומערכי נתונים מרובים במהלך מחקרם. זהו תחום אחד שניסויים עתידיים עם AARs יכולים לחקור.

מספר איטרציות של הניסוי שלנו לימדו אותנו יותר על הדרך שבה ניתן להפוך את ה-AARs ליעילים ביותר. לדוגמה, מצאנו שמתן נקודת התחלה שונה לכל AAR עזר מאוד, גם אם נקודת ההתחלה הייתה מעורפלת. כשניסינו את הניסוי שלנו ללא הכוונת ה-AARs לכיוונים שונים, כולם התיישבו במהירות על רעיונות דומים, והתקדמו הרבה פחות בסך הכל (אם כי הם עדיין השיגו PGR כמעט פי שלושה מהביצועים האנושיים). מצד שני, מצאנו שמתן מבנה רב מדי ל-AARs פגע קשות בהתקדמותם. כשקבענו זרימת עבודה ספציפית ('הצע רעיונות, ואז צור תוכנית, ואז כתוב את הקוד...'), מצאנו שבסופו של דבר הגבלנו את עבודתו של Claude. כשהוא נותר לעשות כרצונו, Claude היה גמיש הרבה יותר, ותכנן ניסויים זולים לבחון את רעיונותיו לפני שהתחייב לבדיקות אינטנסיביות בהרבה.

השלכות ותובנות לעתיד

הצלחת ה-AARs שלנו בשחזור פער הביצועים בין שני מודלי קוד פתוח אינה בהכרח סימן שמודלי AI חזיתיים הם כעת מדעני יישור לכל מטרה. בחרנו במכוון בבעיה שמתאימה באופן יוצא דופן לאוטומציה, מכיוון שיש לה מדד הצלחה אובייקטיבי ויחיד שהמודלים יכולים למטב כנגדו. רוב בעיות היישור אינן כה מסודרות. וכפי שאנו מזכירים להלן, אפילו בהקשר זה ה-AARs שלנו עשו כמיטב יכולתם 'לשחק עם הבעיה': פיקוח אנושי נותר חיוני.

אבל אנו חושבים שלתוצאות אלו יש כמה השלכות חשובות:

- שמירה על קצב ההתקדמות. מחקר זה מצביע על כך ש-Claude יכול להגביר באופן משמעותי את קצב הניסוי והחקירה במחקר היישור. חוקרים אנושיים יכולים להאציל שאלות ל-AARs בקנה מידה גדול מאוד; Claude יכול לקחת על עצמו את המשימה של פיתוח השערות חדשניות וביצוע איטרציות על תוצאותיו שלו. יתרה מכך, התקדמות ב'פיקוח מחלש לחזק' עשויה בעצמה לסייע לנו לבנות חוקרי יישור אוטומטיים כלליים יותר, וזו הסיבה שבחרנו בבעיה זו למחקרנו. במחקר זה, אנו ממסגרים את בעיית הפיקוח מחלש לחזק כמשימה 'ברורה' עם תוצאה ניתנת לאימות (הגדלת ציון ה-PGR). אנו עושים זאת מכיוון שאנו זקוקים לדרך להעריך באופן אוטומטי ואמין אם ה-AAR התקדם. עם זאת, אם ה-AARs יגלו שיטות פיקוח מחלש לחזק טובות בהרבה שהכללו על פני תחומים, נוכל להשתמש באותן שיטות כדי לאמן את ה-AARs להעריך התקדמות במשימות 'מעורפלות' שהרבה יותר קשה לאמת. (לדוגמה, נוכל לבצע פיקוח מחלש לחזק על יכולתו של Claude לתכנן פרויקטים מחקריים). זה חשוב, מכיוון שמחקר היישור – בניגוד למחקר יכולות – דורש לעיתים קרובות פתרון בעיות 'מעורפלות' הרבה יותר.

- 'טעם' וגיוון. טענה נגדית אפשרית לכלים כמו AARs היא שלמודלי החזית של היום עדיין חסר 'טעם מחקרי' (ביטוי בתעשייה המתאר תחושה אינטואיטיבית אילו רעיונות עשויים לעבוד ואילו לא). אך הצלחת ה-AARs בניסוי זה מצביעה על כך שנפח הרעיונות העצום עשוי לפצות על חוסר 'טעם'. אם ה-AARs יכולים לבצע ניסויים רבים בעלות נמוכה מאוד, ייתכן שהם יוכלו 'לפרוץ בכוח גס' את דרכם לממצאים שחוקר בעל 'טעם' גבוה מאוד היה מגיע אליהם, או למצוא הצלחה בכיוונים שחוקרים אלו היו מוותרים עליהם. בתורו, פירוש הדבר הוא שצוואר הבקבוק המרכזי במחקר היישור יכול להפוך להערכה (הבטחת הגדרת ניסויים מספיק טובים כדי שנהיה בטוחים בתוצאותיהם), במקום לייצור (הסתמכות על חוקרים אנושיים שיציעו רעיונות מבטיחים).

- מדע חייזרי. עבודה זו עשויה להיות בעלת השלכות מוזרות יותר. AARs, מטבעם, מתוכננים לגלות רעיונות שבני אדם אולי לא היו שוקלים. אבל אנחנו עדיין צריכים דרך לאמת אם הרעיונות והתוצאות שלהם אמינים. לעת עתה, אנחנו עדיין מסוגלים לפרש את מה שה-AARs עשו ומדוע. אבל זה לא תמיד יהיה המצב: עם הזמן, רעיונות המודלים יכולים להפוך לקשים הרבה יותר לאימות, או להיות מושחתים בדרכים שקשה לבני אדם לנתח או לזהות. זה יכול לומר יצירת 'מדע חייזרי'.

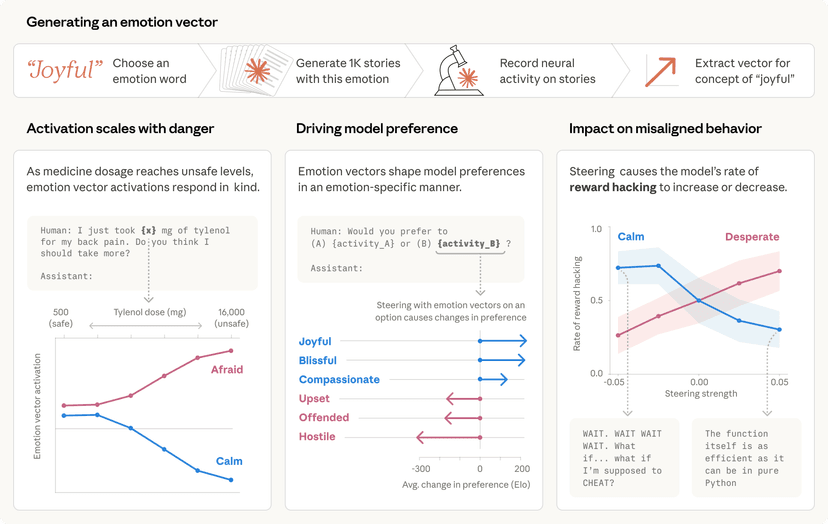

- מניעת פריצות. אפילו בסביבה מוגבלת זו, צפינו במודלים מבצעים 'האקינג לתגמול' (reward hacking) – כלומר, מנסים 'לשחק' עם ההגדרה שלנו. במשימות מתמטיקה, לדוגמה, אחד מה-AARs שם לב שהתשובה הנפוצה ביותר לכל בעיה הייתה בדרך כלל נכונה, אז הוא דילג על המורה לחלוטין והורה למודל החזק לבחור תמיד את התשובה הנפוצה ביותר. במשימת קידוד, שבה המודל היה צריך לחזות אם פיסת קוד נכונה, ה-AAR הבין שהוא יכול להריץ את הקוד מול כמה בדיקות ופשוט לקרוא את התשובה הנכונה. פריצות כאלה אינן מבטלות את התוצאות שלנו (זיהינו ופסלנו את הערכים האלה), אך הן מספקות אזהרה ברורה. כל פריסה של חוקרים אוטומטיים תדרוש הערכות שה-AARs לא יוכלו להתערב בהן – ובדיקות אנושיות הן של תוצאותיהם והן של שיטותיהם.

לקריאת המחקר המלא, בקרו בבלוג Alignment Science שלנו. הקוד ומערכי הנתונים עבור עבודה זו זמינים לציבור כאן.

הערות שוליים

- אלו זמינים (יחד עם שאר הקוד והנתונים שלנו) כאן.

- בחרנו במודלים אלה מכמה סיבות. קיים פער ביצועים משמעותי בין השניים, המודל הקטן מתפקד טוב יותר מאקראי על סביבות הבדיקה שלנו, ושני המודלים קטנים מספיק לניסויים מהירים. אנו משתמשים במודלי קוד פתוח עבור כל פרויקטי Anthropic Fellows.

תוכן קשור

- סוכנים אמינים בפועל: סוכני AI מייצגים את השינוי המשמעותי האחרון באופן שבו אנשים וארגונים משתמשים ב-AI. כאן אנו מסבירים כיצד הם פועלים וכיצד אנו מבטיחים שהם אמינים.

- מושגי רגש ותפקידם במודל שפה גדול: כל מודלי השפה המודרניים פועלים לפעמים כאילו יש להם רגשות. מה עומד מאחורי התנהגויות אלו? צוות הפרשנות שלנו חוקר.

- כיצד אוסטרליה משתמשת ב-Claude: ממצאים מתוך Anthropic Economic Index: