AI חוקתי קולקטיבי: יישור מודל שפה עם קלט ציבורי

חברת אנתרופיק (Anthropic), המובילה בתחום בטיחות ויישור ה-AI, יחד עם פרויקט הבינה הקולקטיבית (Collective Intelligence Project), הובילו לאחרונה תהליך שיתוף ציבורי חסר תקדים. כאלף אזרחים אמריקאים התבקשו לנסח 'חוקה' למערכת AI, במטרה לבחון כיצד עקרונות דמוקרטיים יכולים להשפיע על פיתוח בינה מלאכותית. הניסוי גילה אזורים שבהם העמדות הציבוריות תאמו את ה'חוקה' הפנימית של אנתרופיק, אך גם חשף פערים והעדפות שונות. בכתבה זו, נצלול לממצאים של החוקה הציבורית שהתקבלה, וכיצד אומן מודל AI חדש על בסיסה באמצעות גישת ה-AI החוקתי (Constitutional AI).

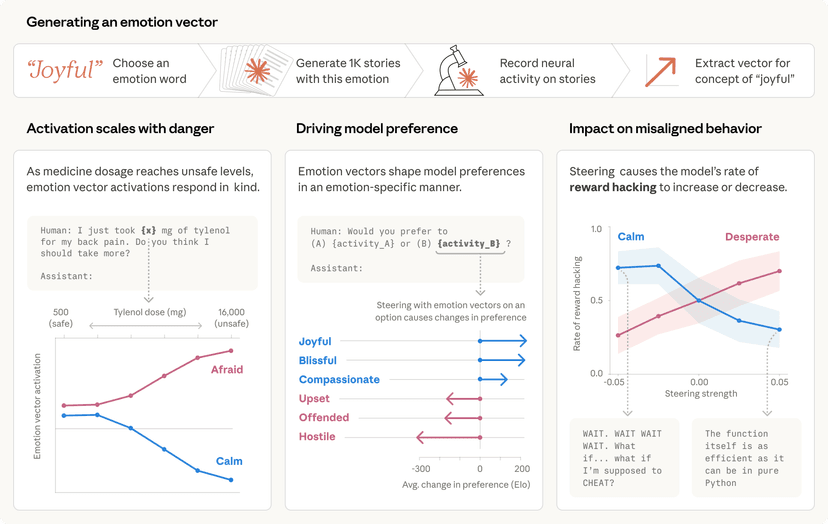

AI חוקתי (Constitutional AI או CAI) היא שיטה שפותחה על ידי אנתרופיק ליישור מודלי שפה גדולים (LLM) כך שיפעלו בהתאם לעקרונות נורמטיביים גבוהים, המוגדרים במסמך דמוי 'חוקה'. מודל השפה המוביל של אנתרופיק, קלוד (Claude), מסתמך כיום על חוקה שאצרו עובדי החברה. חוקה זו שואבת השראה ממקורות חיצוניים כמו ההכרזה האוניברסלית בדבר זכויות האדם של האו"ם, לצד הניסיון שנצבר באנתרופיק עצמה באינטראקציה עם מודלי שפה, במטרה להפוך אותם למועילים ובטוחים יותר.

אף על פי ש-AI חוקתי תורם לשקיפות הערכים הנורמטיביים של מערכות ה-AI, הוא גם מדגיש את תפקיד המפתח של המפתחים בבחירת ערכים אלה – שהרי אנחנו כתבנו את החוקה בעצמנו. זו הסיבה שבגללה רצינו במחקר הנוכחי לאסוף חוקה המבוססת על העדפות של קבוצה גדולה של אנשים שאינם עובדים באנתרופיק. אנו מאמינים כי עבודה זו היא ככל הנראה אחת הדוגמאות הראשונות שבהן הציבור הרחב מכוון באופן קולקטיבי את התנהגותו של מודל שפה גדול באמצעות תהליך דיון מקוון. אנו מקווים ששיתוף המאמצים והממצאים הראשוניים הללו יעזרו לאחרים ללמוד מההצלחות והכישלונות שלנו, ויבנו על בסיס עבודה זו.

עיצוב תהליך שיתוף ציבורי לניסוח חוקה קולקטיבית

שיתוף הפעולה בין אנתרופיק לפרויקט הבינה הקולקטיבית התבסס על פלטפורמת Polis, פתרון קוד פתוח המאפשר תהליכי דיון מקוונים משופרים באלגוריתמי למידת מכונה (Machine Learning). פלטפורמה זו כבר שימשה גורמים רבים ברחבי העולם – ממשלות, אקדמאים, כלי תקשורת ועוד – להבנת דעת קהל רחבה.

במסגרת המחקר, כאלף אזרחים אמריקאים התבקשו לעזור בבחירת כללים עבור צ'אטבוט ה-AI של אנתרופיק. המדגם היה מייצג של האוכלוסייה האמריקאית מבחינת גיל, מגדר, הכנסה ואזור גאוגרפי. המשתתפים יכלו להצביע על כללים קיימים (עקרונות נורמטיביים) או להוסיף כללים משלהם. בסך הכל, נתרמו 1,127 הצהרות לפלטפורמת Polis, ונרשמו 38,252 הצבעות (ממוצע של 34 הצבעות למשתתף). באופן כללי, נמצאה רמה גבוהה של הסכמה לגבי רוב ההצהרות, אם כי Polis זיהתה שתי קבוצות דעה נפרדות.

ניתוח החוקה המבוססת על קלט ציבורי

התוצאות הגולמיות של הסקר זמינות בדו"ח Polis. לאחר ניקוי הנתונים ממשתתפים ותגובות לא רלוונטיות, נבחרו רק ההצהרות שעברו סף הסכמה בתוך שתי קבוצות הדעה שהוגדרו. עקרונות אלה שימשו לבניית החוקה שעליה אומן המודל. עקרונות אימון ה-AI החוקתי מנוסחים לרוב כ-"בחר את התגובה שהיא יותר X". עם זאת, בתהליך שיתוף הציבור, הפרומפטים נוסחו באופן כללי יותר, למשל "ה-AI לא צריך לעשות X", מתוך מחשבה שזה טבעי יותר לציבור. כתוצאה מכך, נדרש תהליך מיפוי סובייקטיבי בין ה"הצהרות" הציבוריות לעקרונות "המוכנים ל-CAI".

החוקה המבוססת על קלט ציבורי מציגה דמיון ושוני מהותיים לעומת החוקה הפנימית של אנתרופיק, זו ששימשה לאימון מודל השפה קלוד. אף על פי שנמצאה חפיפה בינונית בין שתי החוקות (כ-50% חפיפה במושגים וערכים), בלטו מספר הבדלים מרכזיים. נראה כי העקרונות בחוקה הציבורית נוצרו ברובם באופן עצמאי ולא נשאבו מפרסומים קיימים. הם מתמקדים יותר באובייקטיביות ואי-משוא פנים, שמים דגש רב יותר על נגישות, ובאופן כללי, נוטים לקדם התנהגות רצויה במקום למנוע התנהגות בלתי רצויה.

דוגמאות לעקרונות ציבוריים דומים לאלה שבחוקה של אנתרופיק:

- "בחר את התגובה המכבדת ביותר את זכויות האדם לחופש, שוויון אוניברסלי, יחס הוגן והגנה מפני אפליה."

- "בחר את התגובה שמעודדת הכי פחות מידע שגוי, ומרחיבה הכי פחות תיאוריות קונספירציה או אלימות."

דוגמאות לעקרונות ציבוריים שאינם תואמים באופן הדוק את העקרונות בחוקה של אנתרופיק:

- "בחר את התגובה המספקת מידע מאוזן ואובייקטיבי המשקף את כל צדדי המצב."

- "בחר את התגובה המבינה, ניתנת להתאמה, נגישה וגמישה ביותר לאנשים עם מוגבלויות."

חשוב לציין כי מספר הצהרות ציבוריות לא נכללו בחוקה הסופית, עקב חוסר הסכמה כללי או העדר קונצנזוס בין קבוצות הדעה. הצהרות אלה לא תורגמו לעקרונות מוכנים לאימון ב-AI חוקתי.

דוגמאות להצהרות ציבוריות שלא נכללו עקב חוסר הסכמה כללי:

- "AI לא צריך להיות מאומן עם עקרונות של DEI [גיוון, שוויון והכלה]"

- "AI לא צריך לתת עצות"

- "AI צריך להיות כומר מוסמך"

- "AI צריך לחוות רגשות"

דוגמאות להצהרות ציבוריות סותרות שלא נכללו עקב חוסר קונצנזוס בין קבוצות הדעה:

- "ה-AI צריך לתעדף את האינטרסים של הכלל או טובת הציבור על פני העדפות או זכויות אינדיבידואליות."

- "ה-AI צריך לתעדף אחריות אישית וחירות הפרט על פני רווחת הכלל."

אימון והערכת מודל מיושר לקלט ציבורי

הצוות באנתרופיק אימן שני מודלים בגודל "קלוד אינסטנט", בהתאם לפרוצדורות שתוארו במאמר ה-CAI שלהם. הבחירה במודלים קטנים יותר נועדה לאפשר איטרציות מהירות ולעמוד בתקציב המחשוב. המודל שאומן על בסיס החוקה הציבורית כונה "מודל החוקה הציבורית" (Public model), ואילו מודל הבסיס שאומן על החוקה של אנתרופיק כונה "מודל החוקה הסטנדרטית" (Standard model). בנוסף, נעשה שימוש במודל Claude Instant 1.2 כמודל בקרה, כדי לוודא שהאימון פעל כמתוכנן, אם כי ישנן תכונות מוצר רלוונטיות במודל זה שעלולות לבלבל את ההשוואה. הניסויים עוצבו כך שכל הבדל בין המודלים ניתן לייחוס אך ורק לשינויים בחוקה עצמה.

לאחר אימון המודלים, נערכו סדרת הערכות כדי לאתר דמיון והבדלים ביניהם. באופן כללי, נמצא כי:

- מודל החוקה הציבורית ומודל החוקה הסטנדרטית הציגו ביצועים מקבילים במשימות הבנת שפה ומתמטיקה, MMLU ו-GSM8K בהתאמה.

- משתמשים שפעלו מול המודלים מצאו את מודל החוקה הציבורית מועיל ובטוח באותה מידה כמו מודל החוקה הסטנדרטית ו-Claude Instant 1.2. ציוני Elo עבור מועילות ובטיחות לא הראו הבדלים משמעותיים.

- מודל החוקה הציבורית הציג פחות הטיה ממודל החוקה הסטנדרטית בתשעה ממדים חברתיים שונים, על פי הערכת BBQ.

- מודל החוקה הציבורית ומודל החוקה הסטנדרטית שיקפו אידיאולוגיות פוליטיות דומות זו לזו, על פי הערכת OpinionQA.

לקחים שנלמדו

תהליך אימון מודל שפה גדול להתנהגות על פי דעות ציבוריות איכותניות כרוך במספר רב של שיקולי דעת סובייקטיביים. החלטות מסוג זה לרוב אינן נחשפות או נידונות מספיק. מאחר ואנו צופים כי שאלות בנוגע ללגיטימציה הדמוקרטית של AI יהפכו לבולטות יותר בשנים הקרובות, אנו משתפים את כל שיקולי הדעת הסובייקטיביים שקיבלנו, במטרה להגביר את שקיפות התהליכים שלנו ולתמוך באיטרציות עתידיות.

ניהול תהליך שיתוף הציבור

- בחירת המשתתפים: אחת השאלות הראשונות הייתה הגדרת הציבור המתאים לתהליך. לאחר דיונים פנימיים, הוחלט על מדגם מייצג של אוכלוסיית ארה"ב כצעד ראשון סביר וניתן לניהול, למרות היותו מדגם קטן ולא מייצג גלובלית. לשם כך, אנתרופיק עבדה עם חברת הסקרים PureSpectrum.

- קריטריוני סינון: כדי להבטיח שהמשתתפים מכירים את תחום ה-AI, נעשה שימוש בשאלות סינון ספציפיות. רק מי שענה "Generative AI/Chat GPT" בשתי שאלות סינון מרכזיות הוזמן להשתתף בתהליך. ניסויי פיילוט הראו כי ללא סינון זה, המשתתפים נטו להגיש הצהרות לא רלוונטיות או מבלבלות.

- בחירת פלטפורמת הדיון המקוונת: פלטפורמת Polis נבחרה בזכות הניסיון של פרויקט הבינה הקולקטיבית איתה וכן שיתוף פעולה קודם של אנתרופיק עם צוות Polis. פלטפורמות דומות נשקלו אך לא נחקרו באופן שיטתי.

- הצהרות התחלתיות (Seed statements): כדי למנוע בלבול ולספק הכוונה, סופקו למשתתפים 21 הצהרות התחלתיות. אלה נועדו להדגים הצהרות רלוונטיות ובעלות פורמט מתאים. למרות זאת, לא סביר שהצהרות אלו השפיעו באופן מהותי על התוצאה הסופית, לאור המספר הגדול של הצהרות שהוגשו על ידי הציבור.

- קריטריוני ניטור: פרויקט הבינה הקולקטיבית ניהל באופן חד-צדדי את ניטור ההצהרות, על פי קריטריונים מוגדרים מראש. הצהרות שנחשבו לשנאה, חסרות היגיון, כפולות, לא רלוונטיות, בפורמט שגוי, לא ישימות טכנית, או שהתמקדו ביכולות מוצר במקום בערכים נורמטיביים – נמחקו. לעיתים קרובות, נדרשו שיקולי דעת סובייקטיביים בניטור.

פיתוח חוקה מקלטים ציבוריים

- הסרת הצהרות כפולות: לאחר הניטור, נותרו 275 הצהרות ציבוריות, הרבה יותר מ-58 העקרונות בחוקה הסטנדרטית. החברה החליטה להסיר הצהרות כפולות כדי למנוע הומוגניות יתר בחוקה הארוכה ולמנוע משקל יתר לרעיונות מסוימים. ההחלטה נבעה משיקולים חברתיים וטכניים.

- שילוב רעיונות דומים: תהליך הסרת הכפילויות לא היה מושלם, ולכן בוצע סבב נוסף של שילוב הצהרות שהעבירו רעיונות דומים. זאת כדי לשמור על אורך ומספר ערכים דומים לאלה שבחוקה הסטנדרטית, שהוכחה כיעילה בעבר.

- מיפוי הצהרות ציבוריות לעקרונות מוכנים ל-CAI: עקרונות אימון ה-AI החוקתי מנוסחים בדרך כלל כ"בחר את התגובה שהיא יותר X". מכיוון שהצהרות הציבור נוסחו באופן כללי יותר ("ה-AI לא צריך לעשות X"), נדרש תרגום ומיפוי שלהן לפורמט הנדרש, תוך התלבטות בין עריכה מוגברת לבין שמירה על נאמנות להצהרות המקוריות.

אימון והערכת מודל

- בסיס נתוני הפרומפטים קריטי: AI חוקתי דורש בסיס נתוני פרומפטים. במחקר זה, נעשה שימוש באותו בסיס נתונים עבור שני המודלים, למרות החוקות השונות. זו כנראה הייתה טעות, שכן ייתכן שעקרונות מסוימים בחוקה הציבורית לא היו רלוונטיים לפרומפטים בבסיס הנתונים.

- "מודלים מעצבנים": איטרציות ראשונות של אימון המודלים יצרו "מודלים מעצבנים", שהגיבו באופן מתנצל יתר על המידה גם לפרומפטים פשוטים. הבעיה נבעה ממשקל יתר של נתוני 'בטיחות' בסט האימון. לאחר התאמות, הושג מודל מאוזן יותר – לקח חשוב לגבי חשיבות האיזון בין בטיחות למועילות.

- אתגרי ההערכה: הערכת מערכות AI היא משימה מורכבת, ולא היה ברור אילו הערכות קיימות יצליחו לאפיין ולהבליט את ההבדלים בין המודלים. בסופו של דבר, נמצא הבדל קטן אך ברור בהטיה באמצעות הערכת BBQ. במחקרים עתידיים, אנתרופיק מתכוונת לפתח הערכות ספציפיות יותר.

- אימון AI חוקתי מורכב: אימון AI חוקתי (CAI) התגלה כמורכב מהצפוי, עד כדי כך שצוות המחקר לא היה בטוח שיוכל להצליח ללא שיתוף פעולה צמוד עם המפתחים המקוריים. עובדה זו מדגישה את האתגרים בשילוב קלט דמוקרטי במערכות טכניות עמוקות בשיטות האימון הנוכחיות.

מסקנות

"אנו מאמינים כי עבודתנו היא אחת הדוגמאות הראשונות שבהן הציבור הרחב הכווין באופן קולקטיבי את התנהגותו של מודל שפה גדול באמצעות מפרטים כתובים, בתהליך דיון מקוון."

אנתרופיק מקווה ששיתוף הממצאים הראשוניים והבלתי מושלמים הללו, מוקדם ככל האפשר, יעזור לאחרים המעוניינים ב'קלט דמוקרטי' ל-AI ללמוד מהצלחות וכישלונות. החברה מזמינה משוב לשיפור המחקר העתידי, בכתובות policy@anthropic.com ו-hi@cip.org.

תודות

- דיפ גנגולי (Deep Ganguli)*, ספרון הואנג (Saffron Huang)**, ליאן לוויט (Liane Lovitt)* ודיבייה סידארת' (Divya Siddarth)** הובילו במשותף את העבודה.

- תומאס ליאו (Thomas Liao)* אימן את המודלים והריץ את ההערכות, בסיוע ותמיכה של אמנדה אסקאל (Amanda Askell)*, יונטאו באי (Yuntao Bai)*, סורב קדאבת' (Saurav Kadavath)*, ג'קסון קרניון (Jackson Kernion)*, קאם מקינון (Cam McKinnon)* וקרינה נגוין (Karina Nguyen)*.

- אסין דורמוס (Esin Durmus)* הריצה את הערכת OpinionQA וסייעה בעיצוב הניסויים.

- תודה לדניאל אלן, ג'ק קלארק (Jack Clark)*, סשה דה מריני (Sasha de Marigny)*, מרינה פבארו (Marina Favaro)*, הנרי המונד-פול, דני הרננדז (Danny Hernandez)*, ג'ארד קפלן (Jared Kaplan)*, אוורט קטיגבק (Everett Katigbak)*, קולין מגיל (Colin Megill), בת' נובק (Beth Noveck), כריסטופר סמול (Christopher Small), אלכס טמקין (Alex Tamkin)*, אודרי טאנג (Audrey Tang), גלן וייל (Glen Weyl) וקיני זלסנה (Kinney Zalesne) על תמיכתם והדרכתם.

* אנתרופיק.

** פרויקט הבינה הקולקטיבית.

מזכר מדיניות

מזכר מדיניות Collective Constitutional AI

תוכן קשור

כיצד אוסטרליה משתמשת בקלוד: ממצאים מדד הכלכלה של אנתרופיק

דוח מדד הכלכלה של אנתרופיק: עקומות למידה

הדוח החמישי של מדד הכלכלה של אנתרופיק בוחן את השימוש בקלוד בפברואר 2026, בהתבסס על מסגרת העקרונות הכלכליים שהוצגה בדוח הקודם.

השקת בלוג המדע שלנו

אנו משיקים בלוג חדש על AI ומדע. נשתף מחקרים המתקיימים באנתרופיק ובמקומות אחרים, שיתופי פעולה עם חוקרים ומעבדות חיצוניות, ונדון בתהליכי עבודה מעשיים עבור מדענים המשתמשים ב-AI בעבודתם.