המהפכה של ה-AI מציבה בפנינו לא רק הזדמנויות בלתי רגילות, אלא גם אתגרים מורכבים, במיוחד בכל הנוגע לבטיחות ולפיקוח על מערכות שהולכות ונעשות חזקות יותר. אחד האתגרים המרכזיים שחברת המחקר והבטיחות אנתרופיק (Anthropic) מתמודדת איתו הוא "פיקוח מדרגי" (scalable oversight) – כיצד נוכל לפקח ביעילות על מודלי בינה מלאכותית שעלולים להצטיין מעל ליכולות אנושיות במגוון רחב של משימות? במחקר חדש שפרסמה החברה, היא מציגה גישה חדשנית למדידת התקדמות בבעיה זו, ומספקת הוכחת היתכנות מבטיחה.

האתגר: לפקח על AI חזק מהאדם

פיתוח מערכות AI כלליות בטוחות ושימושיות ידרוש מאיתנו להתקדם משמעותית בבעיית הפיקוח המדרגי. הדילמה פשוטה לכאורה, אך מורכבת ליישום: כיצד מפקחים על מערכת שיש לה יתרון על פנינו ברוב הכישורים הרלוונטיים למשימה הנתונה? העבודה האמפירית על בעיה זו אינה פשוטה, שכן נכון להיום, עדיין אין ברשותנו מערכות AI שחורגות באופן גורף מיכולותינו האנושיות הרחבות.

עיצוב הניסוי: היכן האדם והמודל משלימים זה את זה?

אנתרופיק מציגה דרך מרכזית שבה היא מתייחסת לבעיה זו, תוך התמקדות בדרכים שבהן ניתן לחקור אותה באופן אמפירי. התכנון הניסויי של החברה מתרכז במשימות שבהן מומחים אנושיים מצליחים, אך בני אדם ללא סיוע עצמי ומערכות AI כלליות נוכחיות נכשלים. הרעיון הוא ליצור מצב שבו שיתוף פעולה בין אדם למודל, גם אם המודל אינו מושלם, יכול להוביל לתוצאות טובות יותר מאשר כל אחד מהם בנפרד.

הוכחת היתכנות: אדם ו-LLM מנצחים יחד

כדי להדגים את היתכנות הגישה, אנתרופיק ערכה ניסוי הוכחת היתכנות (proof-of-concept experiment) שמטרתו להציג תכונה מרכזית בעיצוב הניסוי ולהראות את יכולתו להתקיים. הניסוי נערך באמצעות שתי משימות מענה על שאלות: MMLU ו-QuALITY מוגבל ב-זמן (time-limited QuALITY).

הממצאים היו מעודדים במיוחד: משתתפים אנושיים שאינטראקציה עם עוזר דיאלוגי מבוסס LLM לא אמין באמצעות צ'אט – אסטרטגיה בסיסית ופשוטה במיוחד לפיקוח מדרגי – עלו באופן ניכר בביצועיהם גם על המודל לבדו וגם על ביצועיהם שלהם ללא סיוע. המשמעות היא שאפילו אינטראקציה פשוטה יחסית עם מודל שפה גדול, גם אם אינו מושלם, יכולה לשפר דרמטית את יכולת האדם לבצע משימות מורכבות.

התוצאות הן סימן מעודד לכך שפיקוח מדרגי יהיה בר ביצוע למחקר עם המודלים הקיימים, ומחזקות ממצאים עדכניים לפיהם מודלי שפה גדולים יכולים לסייע באופן פרודוקטיבי לבני אדם במשימות קשות.

השלכות וקדימה: עתיד שיתוף הפעולה בין אדם ל-AI

מחקר זה מדגיש את הפוטנציאל העצום בשילוב היכולות של בני אדם ושל מודלי AI מתקדמים. הוא מהווה צעד חשוב קדימה בהבנה כיצד נוכל לבנות מערכות בינה מלאכותית לא רק חזקות, אלא גם בטוחות, אמינות וניתנות לשליטה, תוך שילוב אפקטיבי של הפיקוח האנושי.

עוד מאנתרופיק: הצצה למחקרים ודוחות נוספים

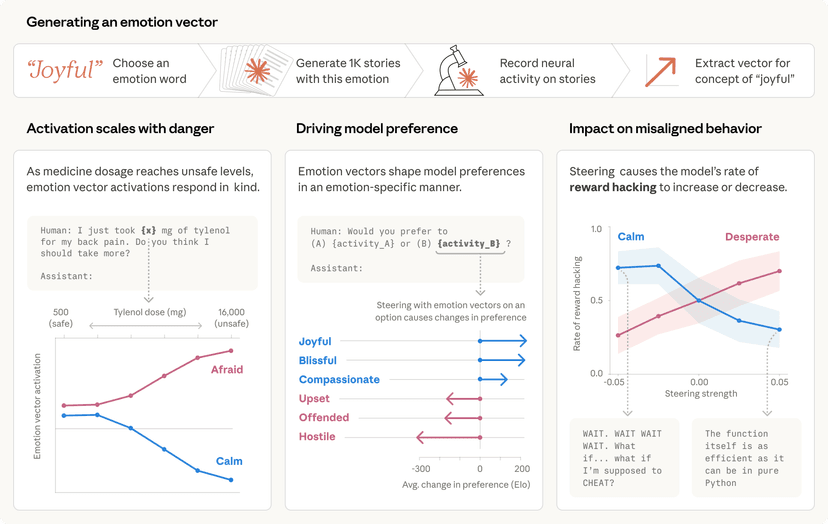

בנוסף למחקר זה, אנתרופיק ממשיכה לפרסם עבודות ותובנות מרתקות מתחום ה-AI. בין היתר, החברה בוחנת סוגיות כמו "מושגי רגש ותפקידם במודל שפה גדול" (Emotion concepts and their function in a large language model). כמו כן, החברה מפרסמת באופן קבוע דוחות תובנות כלכליים, דוגמת "מדד אנתרופיק הכלכלי: עקומות למידה" (Anthropic Economic Index report: Learning curves). דוח זה, שפורסם כחלק מהמדד הכלכלי החמישי של החברה, בחן את השימוש ב-Claude בחודש פברואר 2026, והתבסס על מסגרת העקרונות הכלכליים שהוצגה בדוח הקודם, ומספק הצצה חשובה למגמות האימוץ והשימוש במודלי שפה גדולים בעולם האמיתי.