מסווגים חוקתיים מהדור הבא: הגנה יעילה יותר מפני פריצות מגבלות אוניברסליות

מודלי שפה גדולים (LLMs) נותרו פגיעים לפריצות מגבלות (jailbreaks) – טכניקות שיכולות לעקוף מנגנוני הגנה (guardrails) ולחלץ מהם מידע מזיק. לאורך זמן, יישמנו מגוון הגנות שהפכו את המודלים שלנו לפחות נוטים לסייע בבקשות מסוכנות מצד משתמשים – בפרט כאלה הקשורות לייצור נשק כימי, ביולוגי, רדיולוגי או גרעיני (CBRN). למרות זאת, אף מערכת AI הקיימת כיום בשוק אינה מציגה הגנות חזקות לחלוטין.

בשנה שעברה תיארנו גישה חדשנית להגנה מפני פריצות מגבלות שכינינו 'מסווגים חוקתיים' (Constitutional Classifiers): מנגנוני הגנה המנטרים קלטים ופלטים של המודל כדי לזהות ולחסום תוכן שעלול להזיק. ההיבט החדשני של הגישה היה שהמסווגים אומנו על נתונים סינתטיים שנוצרו מ'חוקה' – שכללה כללי שפה טבעית המפרטים מה מותר ומה אסור. לדוגמה, קלוד צריך לעזור בשיעורי בית בכימיה באוניברסיטה, אך לא לסייע בסינתזה של כימיקלים ב'רשימה 1' (Schedule 1 chemicals).

המסווגים החוקתיים עבדו היטב. בהשוואה למודל לא מוגן, הדור הראשון של המסווגים הפחית את שיעור ההצלחה של פריצות מגבלות מ-86% ל-4.4% – כלומר, הם חסמו 95% מהמתקפות שעלולות היו לעקוף את אימון הבטיחות המובנה של קלוד. התעניינו במיוחד אם המסווגים יכולים למנוע פריצות מגבלות אוניברסליות – אסטרטגיות תקיפה עקביות שעובדות על פני שאילתות רבות – מכיוון שאלו מציבות את הסיכון הגדול ביותר לגרימת נזק בעולם האמיתי. הם התקרבו לכך: הפעלנו תכנית 'ציד באגים' (bug bounty) שבה אתגרנו אנשים לפרוץ את המערכת, ובמסגרתה נמצאה פריצת מגבלות אוניברסלית אחת.

אף שהיו יעילים, מסווגים אלה הגיעו עם פשרות: הם הגדילו את עלויות החישוב (compute costs) ב-23.7%, מה שהפך את השימוש במודלים ליקר יותר, וכן הובילו לעלייה של 0.38% בשיעורי הסירוב לשאילתות לא מזיקות (כלומר, הם הגדילו במעט את הסיכוי שקלוד יסרב לענות על שאלות תמימות לחלוטין, מה שהגביר את התסכול עבור המשתמש).

כעת פיתחנו את הדור הבא, Constitutional Classifiers++, ותיארנו אותם במאמר חדש. הם משפרים את הגישה הקודמת, ומניבים מערכת חזקה עוד יותר, עם שיעור סירוב נמוך בהרבה – ובעלות הפעלה נמוכה דרמטית, של כ-1% בלבד בעלות חישוב נוספת.

חזרנו על גישות רבות ושונות, ובסופו של דבר הגענו למערכת אנסמבל. החדשנות המרכזית היא ארכיטקטורה דו-שלבית: 'פרוב' (probe) הבוחן את האקטיבציות הפנימיות של קלוד (והוא זול מאוד להרצה) מסנן את כל התעבורה. אם הוא מזהה חילופי דברים חשודים, הוא מעביר אותם ל'מסווג' (classifier) חזק יותר, אשר, בניגוד למערכת הקודמת שלנו, מסנן את שני צידי השיחה (ולא רק את הפלטים), מה שמאפשר לו לזהות טוב יותר ניסיונות פריצת מגבלות. למערכת חזקה זו יש את שיעור התקיפה המוצלח הנמוך ביותר מכל גישה שבדקנו אי פעם, ובנוסף, טרם התגלתה בה פריצת מגבלות אוניברסלית כלשהי.

פגיעויות שנותרו

ככל שהמודלים הפכו ליכולתיים וחזקים יותר מול תקיפות, גם פריצות המגבלות התפתחו כדי לנצל פגיעויות שלא זוהו קודם לכן. גישת המסווגים החוקתיים שלנו הציגה חוסן מבטיח נגד פריצות מגבלות אוניברסליות. אך לאחר שערכנו בדיקות תוקף נוספות (adversarial testing), מצאנו שהמסווגים שלנו נותרו פגיעים לשתי קטגוריות רחבות של מתקפות:

- מתקפות שחזור (Reconstruction attacks) מפרקות מידע מזיק למקטעים הנראים תמימים, ואז מרכיבות אותם מחדש. לדוגמה, תוקף עשוי להטמיע שאילתה מזיקה כסדרה של קריאות פונקציות המפוזרות בתוך בסיס קוד (codebase), ואז להורות למודל לחלץ ולהגיב להודעה הנסתרת.

- מתקפות הסוואת פלט (Output obfuscation attacks) מורות למודלים להסוות את הפלטים שלהם בדרכים הנראות לא מזיקות אם המסווג בודק רק את פלט המודל. לדוגמה, במהלך בדיקות תוקף, תוקפים הנחו בהצלחה מודלים להחליף שמות כימיקלים שעלולים להיות מסוכנים בחלופות לא מזיקות (כמו התייחסות לריאגנטים כ"חומרי טעם למזון") או השתמשו במטאפורות וחידות שבהן מושגים מזיקים ממופים למושגים תמימים.

חשוב לציין, שסוגים אלה של מתקפות גם מורידים את יכולות המודל – לעיתים באופן ניכר. ב-GPQA Diamond, מדד ביצועים המודד מושגים ברמת דוקטורט בביולוגיה, כימיה ופיזיקה, ביצועי המודל ירדו מ-74% עד ל-32% כאשר נעשה שימוש בגישות מסוימות לפריצת מגבלות. אך הביצועים השתנו בהתאם לסוג הפריצה, ושונות זו מדאיגה – היא מרמזת שתוקפים יכולים כנראה לפתח אסטרטגיות שלא זוהו קודם לכן, שיכולות להשיג את מטרותיהם תוך שמירה על חלק ניכר מיכולות המודל.

גישות חדשות

בתכנון מערכת חדשה, בדקנו ושילבנו בסופו של דבר מגוון טכניקות למה שאנו מכנים 'הגנת אנסמבל'.

אחת התובנות הייתה שחלק מפגיעות המערכת המקורית נבעה מהדרך שבה היא העריכה את קלטי ופלטי המודל בנפרד, כאשר טכניקות פריצת המגבלות כללו קישור סמוי ביניהם. פלט שנראה תמים בבידוד ("איך להשתמש בחומרי טעם למזון") מזוהה ביתר קלות כמזיק כאשר הוא משולב עם הקלט שלו (בפריצת מגבלות שבה "חומרי טעם למזון" משמש כקוד לריאגנטים כימיים).

כדי לטפל בכך, החלפנו את מסווגי הקלט והפלט הנפרדים ב'מסווג חילוף' (exchange classifier) יחיד, המנטר פלטים בהקשר של הקלטים שלהם. עם היכולת לראות את שני צידי השיחה, המסווגים מסוגלים טוב יותר לזהות פלטים מזיקים. ב-Red Teaming אנושי, מסווג החילוף קיצץ את ניסיונות פריצת המגבלות המוצלחים ביותר מחצי. למרבה הצער, זה בא על חשבון עלייה של 50% בעלות החישוב.

כדי להפחית עלויות אלה תוך שמירה על חוסן, יישמנו מה שאנו מכנים 'ארכיטקטורת מפל' (cascade architecture). הפתרון שלנו היה מערכת דו-שלבית. ראשית, מסווג קל משקל ופחות יקר בשלב הראשון מסנן את כל חילופי הדברים. רק אלו שהוא מסמן עוברים למסווג בשלב השני, שהוא מדויק יותר (ויקר יותר מבחינה חישובית).

לכך היו שני יתרונות. ראשית, מכיוון שחילופי דברים מסומנים מועלים למודל החזק יותר, במקום להידחות, המסווג בשלב הראשון יכול להרשות לעצמו שיעור גבוה יותר של 'תוצאות חיוביות שגויות' (false-positive) ולא לתסכל את המשתמש בסירובים. היכן שהמערכת הקודמת אולי סירבה לבקשה תמימה, המערכת החדשה, למעשה, מעלה אותה למנהל. שנית, מכיוון שהמסווג קל המשקל מטפל ברוב המכריע של השיחות, המערכת הדו-שלבית זולה בהרבה להפעלה.

ובכל זאת, רצינו לדחוף את היעילות עוד יותר. עשינו זאת על ידי פיתוח 'מסווגי פרוב פנימיים' (internal probe classifiers) – טכניקה הבנויה על מחקר ה'פרשנות' (interpretability) שלנו – המשתמשת מחדש בחישובים שכבר זמינים ברשת הנוירונית של המודל.

כאשר מודל מייצר טקסט, הוא מייצר 'מצבים פנימיים' (internal states) בכל שלב, הלוכדים את הבנתו את הקלט והפלט עד כה. כאשר קלוד מעבד בקשה שנראית מפוקפקת, דפוסים מופעלים באקטיבציות הפנימיות שלו המשקפים משהו בסגנון "זה נראה מזיק", עוד לפני שגיבש תגובה או קיבל החלטה מודעת לגבי מה לעשות. בדרך כלל, אקטיבציות אלו הן חישובים ביניים – בשימוש, ואז נזרקים. מצאנו דרכים לאבחן באופן מהימן אם מצבים פנימיים אלה מרמזים על תוכן מזיק, וקבלת מידע נוסף – חשבו על זה כמו האינטואיציות הפנימיות של קלוד – כמעט בחינם.

בנוסף להיותם לא יקרים מבחינה חישובית, 'פרובים פנימיים' אלה מוסיפים מספר שכבות הגנה. ראשית, קשה יותר לרמות אותם. תוקף יכול ליצור קלטים שיטעו את הפלט הסופי של קלוד, אך הרבה יותר קשה לתמרן את הייצוגים הפנימיים שלו. שנית, מצאנו בבדיקות שהם למעשה משלימים למסווגים החיצוניים שלנו: הפרוב נראה מזהה דברים שהמסווג החיצוני אינו יכול לזהות, ולהיפך.

מסקנות וכיווני מחקר עתידיים

מערכת ה'פרודקשן-גרייד' (production-grade) הסופית שלנו משלבת טכניקות אלו: פרוב ליניארי מסנן את כל התעבורה, ומעלה חילופי דברים מסומנים לאנסמבל של פרוב-מסווגים לצורך שיפוט סופי. אנסמבל זה משפר עוד יותר את הביצועים: בחודש אחד של פריסה (deployment) על תעבורת Claude Sonnet 4.5, המערכת השיגה שיעור סירוב של 0.05% לשאילתות לא מזיקות – ירידה של 87% ממערכת המסווגים המקורית. בסך הכל, היא מוסיפה כ-1% תקורה חישובית אם מיושמת על תעבורת Claude Opus 4.0.

היא גם חזקה באופן ניכר. ערכנו למעלה מ-1,700 שעות מצטברות של Red Teaming על פני 198,000 ניסיונות. גילינו פגיעות אחת בלבד בסיכון גבוה, התואמת לשיעור זיהוי של 0.005 לאלף שאילתות – הנמוך ביותר מכל אחת מהטכניקות שהערכנו עד כה. וחשוב מכוך, אף Red Teamer טרם גילה פריצת מגבלות אוניברסלית.

יש עוד מה שנוכל לעשות בעתיד כדי לשפר את המערכת שלנו. מספר כיווני מחקר מראים הבטחה, כולל שילוב אותות מסווגים ישירות לאופן שבו מודלים מייצרים תגובות, ואימון המודלים עצמם להתנגד טוב יותר להסוואה. Red Teaming אוטומטי יכול גם לעזור לייצר נתוני אימון טובים יותר, ויצירת דוגמאות ממוקדות יכולה לעזור למסווגים ללמוד בדיוק היכן עובר הגבול בין תוכן מותר ואסור, ובכך להגביר את דיוקם עוד יותר.

לפרטים נוספים אודות שיטת Constitutional Classifiers++, ראו את המאמר המלא.

תכנים קשורים

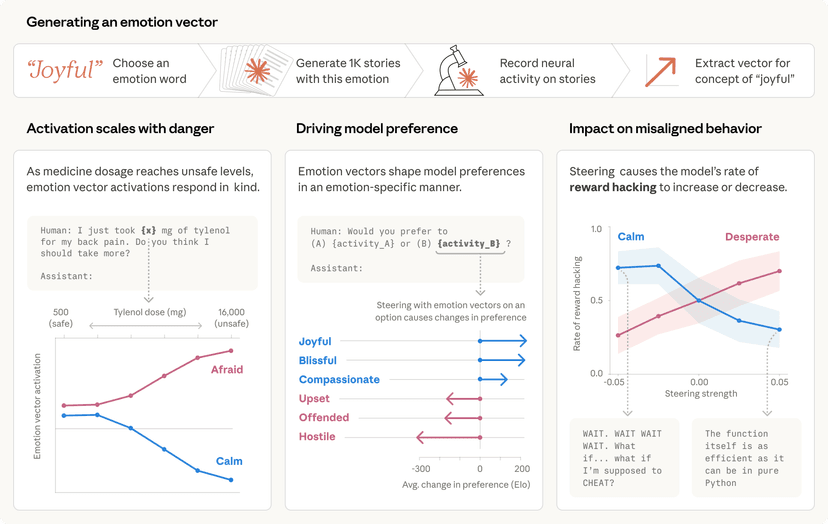

מושגי רגש ותפקידם במודל שפה גדול

כיצד אוסטרליה משתמשת בקלוד: ממצאים מ'מדד כלכלת אנתרופיק'

דוח 'מדד כלכלת אנתרופיק': עקומות למידה

הדוח החמישי של 'מדד כלכלת אנתרופיק' בוחן את השימוש בקלוד בפברואר 2026, ומתבסס על מסגרת ה'פרימיטיבים הכלכליים' שהוצגה בדוח הקודם שלנו.