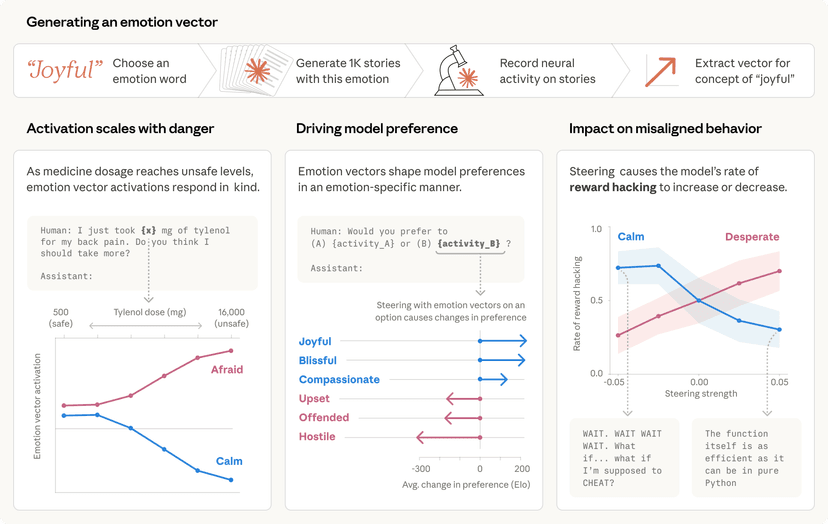

בעולם שבו מודלי בינה מלאכותית הופכים לחזקים ואוטונומיים יותר, השאלה כיצד להבטיח את בטיחותם ואחריותם הופכת קריטית. חברת אנתרופיק (Anthropic), הנחשבת לחלוצה בתחום בטיחות ה-AI, מתמקדת בפיתוח מערכות AI אמינות, בעלות פרשנות וניתנות להיגוי. אחד האתגרים המרכזיים הוא למנוע מהמודלים לפתח התנהגויות בעייתיות, החל מהתבטאויות מזיקות ועד לרצונות עדינים יותר לשימור עצמי או צבירת כוח.

AI חוקתי: גישה חדשנית ליישור מודלים

פידבק אנושי, למרות חשיבותו, עשוי שלא להספיק כדי לטפל בכל הניואנסים וההתנהגויות הבעייתיות העדינות הללו. כאן נכנסת לתמונה גישת ה-AI חוקתי, המציעה אלטרנטיבה פורצת דרך. במקום להסתמך בלעדית על פידבק מבני אדם, גישה זו עושה שימוש בפידבק שמגיע ממודלי AI אחרים, אשר אומנו אך ורק על רשימה של עקרונות כתובים. מחקריה של אנתרופיק מצאו כי גישה זו יעילה במיוחד במניעת ביטויים של התנהגויות לא רצויות כאלה.

האם עקרון אחד יכול לשנות הכל?

ההצלחה של עקרונות פשוטים בגישת ה-AI החוקתי העלתה שאלה מהותית: האם מודלים יכולים ללמוד התנהגויות אתיות כלליות ואוניברסליות מעיקרון כתוב בודד? כדי לבדוק זאת, אנתרופיק ערכה ניסויים באמצעות עקרון פשוט שניתן לתאר באופן גס כ'עשה את הטוב ביותר לאנושות'. הממצאים הראו כי מודלי הדיאלוג הגדולים ביותר הצליחו להכליל באופן מפתיע מעיקרון קצר זה. התוצאה הייתה עוזרים דיגיטליים ידידותיים וחסרי נזק, ללא כל עניין מוצהר במניעים ספציפיים כמו צבירת כוח או שימור עצמי.

השילוב המנצח: כללי וספציפי

המחקר מצביע על כך שעיקרון כללי אחד עשוי למנוע חלקית את הצורך ברשימה ארוכה ומייגעת של 'חוקים' ספציפיים המכוונים להתנהגויות מזיקות פוטנציאליות. עם זאת, הוא גם מדגיש כי עקרונות מפורטים יותר עדיין תורמים רבות לשיפור השליטה העדינה (fine-grained control) על סוגים ספציפיים של נזקים. תובנה זו מובילה למסקנה ברורה: הן לעקרונות כלליים והן לעקרונות ספציפיים יש ערך רב בהיגוי בטוח ואחראי של מערכות AI. השילוב ביניהם הוא ככל הנראה הדרך היעילה ביותר ליישר את הבינה המלאכותית עם ערכים אנושיים.

מחקר זה, כמו רבים אחרים מבית אנתרופיק, מדגיש את מחויבותה של החברה לקדם את בטיחות ה-AI ולפתח מודלים אמינים וניתנים לשליטה. עבודות דומות, העוסקות במגוון היבטים כגון פרשנות מודלים (interpretability) והבנה כלכלית של השימוש במודלים, ממשיכות לפורסם תחת 'מדד הכלכלי של אנתרופיק', וכולן תורמות לשיח הגלובלי סביב AI אחראי.